为什么AI音频增强听起来很金属化(以及如何修复)

播客、视频创作者和采访者的常见抱怨是AI增强的音频有时听起来很金属化、人工、机器人化或过度处理。这不是微妙的。在许多情况下,增强版本听起来比原始版本更糟。

我从尝试过AI音频增强工具的创作者那里无数次听到这种反馈,结果只是得到听起来像被机器人处理过的音频。本文解释了引擎盖下真正出了什么问题,为什么这发生在某些工具上比其他工具更多,以及今天最可靠的修复方法是什么。

真正的原因:过度抑制和强制重建

大多数人抱怨的金属或机器人声音不是随机的。它几乎总是来自相同的技术权衡。

大多数AI增强器同时做两件事。它们激进地抑制噪音和混响,然后在信息被移除的地方重建语音。当抑制走得太远时,模型不仅移除噪音,还移除声音中的微细节、自然谐波和使语音听起来像人类的微妙房间线索。

为了补偿,模型然后重建它认为缺失的信号部分。这种重建是金属或合成质感出现的地方。我处理过AI移除太多以至于必须猜测声音应该听起来如何的录音,这些猜测往往听起来人工。

为什么这发生在某些AI工具上比其他工具更多

在测试各种AI增强工具后,我注意到哪些产生金属或机器人伪影,哪些不产生的清晰模式。

一刀切的处理

许多增强器,特别是免费或免费增值的,对所有音频应用单一的激进配置文件。该配置文件旨在在糟糕的录音上给人留下深刻印象,尽可能多地移除噪音,并产生明显的之前/之后比较。

问题是并非所有录音都需要激进的清理。声音在音色上差异很大,房间和麦克风的行为也不同。没有适应,模型会过度,伪影就会出现。

我看到同一个工具在一个录音上产生完美结果,在另一个上产生金属伪影,仅仅因为它对两者使用相同的激进设置。

无法控制处理强度

如果工具不允许你降低强度,你就被困在模型认为最好的任何东西上。这就是为什么用户经常报告免费层级听起来比付费层级更刺耳,金属或机器人伪影在免费版本中出现得更频繁。

你听到的是没有逃生舱的过度校正。我通过免费工具处理过听起来不错但具有那种微妙机器人质量的录音,如果不升级,我无法做任何事情来修复它。

生成捷径而非保守恢复

某些增强器过于依赖生成重建而非保守降噪。这对于极其糟糕的音频和演示风格的转换效果很好,但对于真实语音,它增加了合成音色、机器人质感和说话者身份丢失的风险。

模型开始发明语音而不是揭示它。我处理过AI增强使说话者听起来像完全不同的人的录音,声音在技术上干净但完全不自然。

为什么在后期制作中修复很少有效

一旦引入金属或机器人伪影,均衡无法完全移除它们。去齿音只掩盖症状,进一步降噪往往使情况更糟。这是因为问题被"烘烤"到信号中。

在这一点上,真正的修复不是另一个插件。它首先是不创建伪影。我试图用手动编辑软件修复过度处理的音频,虽然你可以稍微改善它,但你永远无法完全恢复丢失的自然特征。问题是,一旦伪影被"烘烤"进去,即使专业编辑工具也很难完全移除它们。

唯一可靠的修复:使用优先考虑自然性的增强器

在实践中,停止看到金属或机器人伪影的创作者转向默认保守、适应输入处理、保留声音谐波、避免激进生成填充并瞄准自然语音而非最大清理的增强器。

这就是为什么某些工具即使在重回声、嘈杂房间、远程采访和视频音频中也能持续产生干净结果,而其他工具在这些情况下失败。差异不在于它们清理多少,而在于它们如何平衡清理与保留。有关优先考虑自然性的详细音频增强器比较,请参阅我们对今天可用的最佳工具的指南。

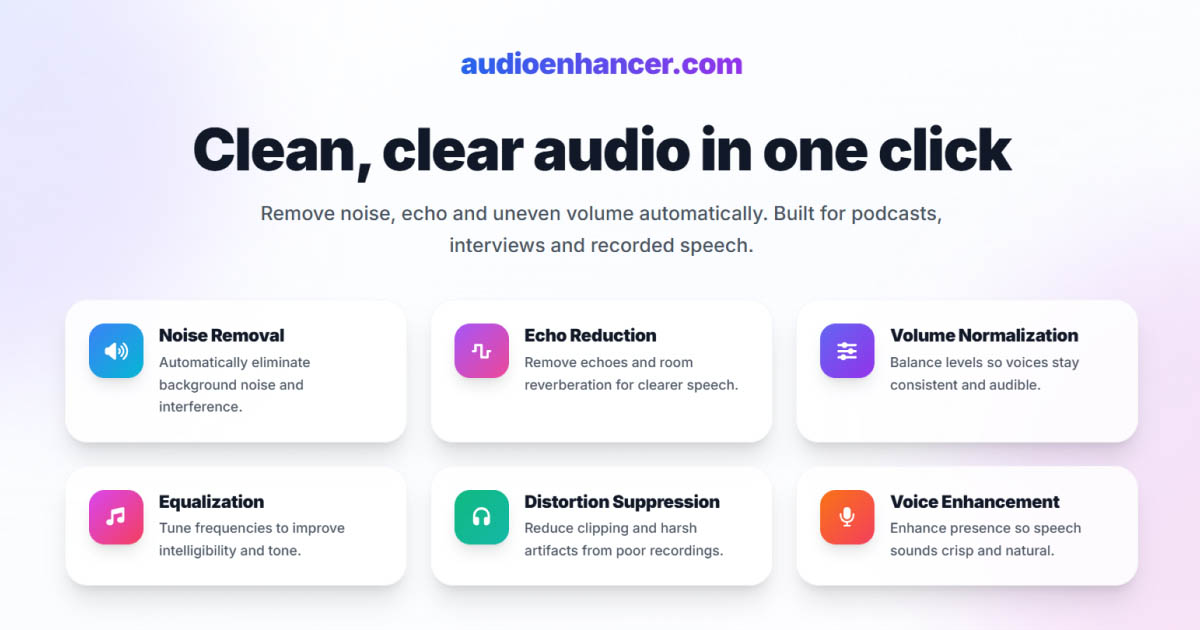

AudioEnhancer.com 的定位

AudioEnhancer.com 围绕一个核心约束构建:永远不要通过破坏声音来修复音频。与其将抑制推到极限,它专注于保留声音质感,减少回声和噪音而不使谐波变平,避免许多工具引入的AI光泽,并产生仍然听起来像真人的语音。

这就是为什么,在实践中,它处理困难录音而不会出现用户与AI增强相关的金属或机器人伪影。不是因为它清理得更用力,而是因为它知道何时不这样做。

如果你想自己听到差异,请查看我们主页上的音频样本。你可以比较具有重噪音和回声的录音在增强前后的情况,你会注意到增强版本保持自然声音特征,没有那种金属或机器人质量。

总结

金属或机器人声音的音频增强发生在工具优先考虑激进清理而非自然性时。修复不是添加更多处理。它是使用理解清理音频和保留使人类语音听起来像人类的东西之间的差异的工具。

当增强器知道何时停止时,你获得专业质量的结果而没有伪影。当它不知道时,你获得技术上干净但听起来像被机器人处理过的音频。