Porque é que a melhoria de áudio com IA soa metálica (e como resolver)

Uma das queixas mais comuns de podcasters, criadores de vídeo e quem grava entrevistas é que o áudio “melhorado” com IA às vezes soa metálico, artificial, robótico ou over-processed.

Isto não é subtil.

Em muitos casos, a versão “melhorada” soa pior do que a original.

Já ouvi este feedback vezes sem conta de criadores que experimentaram ferramentas de melhoria de áudio com IA e acabaram com som “de robô”.

Aqui explico o que está a acontecer “por baixo do capô”, porque é que isto acontece mais com algumas ferramentas do que com outras e qual é, hoje, a correção mais fiável.

A causa real: over-suppression + reconstrução forçada

O som metálico/robótico raramente é aleatório.

Quase sempre vem do mesmo trade-off técnico.

Muitos enhancers fazem duas coisas em simultâneo:

- suprimem ruído e reverb de forma agressiva

- reconstroem fala onde o modelo acha que “faltou” informação

Quando a supressão vai longe demais, o modelo remove não só ruído, mas também micro-detalhe da voz, harmónicos naturais e pistas subtis de ambiente que fazem a fala soar humana.

Para compensar, o modelo tenta reconstruir o sinal.

É nessa reconstrução que aparece a textura metálica/sintética.

Já processei gravações onde a IA removeu tanto que teve de “adivinhar” como a voz devia soar, e esses palpites soaram artificiais.

Porque é que isto acontece mais com algumas ferramentas

Depois de testar várias ferramentas, há padrões claros.

Processamento “one-size-fits-all”

Muitos enhancers, especialmente free/freemium, aplicam o mesmo perfil agressivo a tudo.

O objetivo é impressionar em gravações más e mostrar um antes/depois muito óbvio.

O problema é que nem todas as gravações precisam desse nível de limpeza.

Vozes têm timbres diferentes.

Salas e microfones comportam-se de forma diferente.

Sem adaptação, o modelo exagera, e aparecem artefactos.

Falta de controlo de intensidade

Se a ferramenta não permite reduzir intensidade, ficas preso ao que o modelo decidiu.

Isto explica porque versões grátis muitas vezes soam mais duras do que versões pagas.

Ouves over-correction sem “escape hatch”.

Atalhos generativos em vez de restauro conservador

Algumas ferramentas apoiam-se demasiado em reconstrução generativa em vez de denoise conservador.

Isso pode funcionar para áudio muito mau.

Mas em fala real, aumenta o risco de timbre sintético e perda de identidade do orador.

O modelo começa a inventar fala em vez de revelar a fala.

Porque “corrigir em pós” raramente resolve

Depois de introduzidos, estes artefactos raramente saem com EQ.

De-essing apenas mascara sintomas.

E mais redução de ruído muitas vezes piora.

O problema fica “colado” ao sinal.

Mesmo com edição manual dá para melhorar um pouco, mas é difícil recuperar o carácter natural que foi perdido.

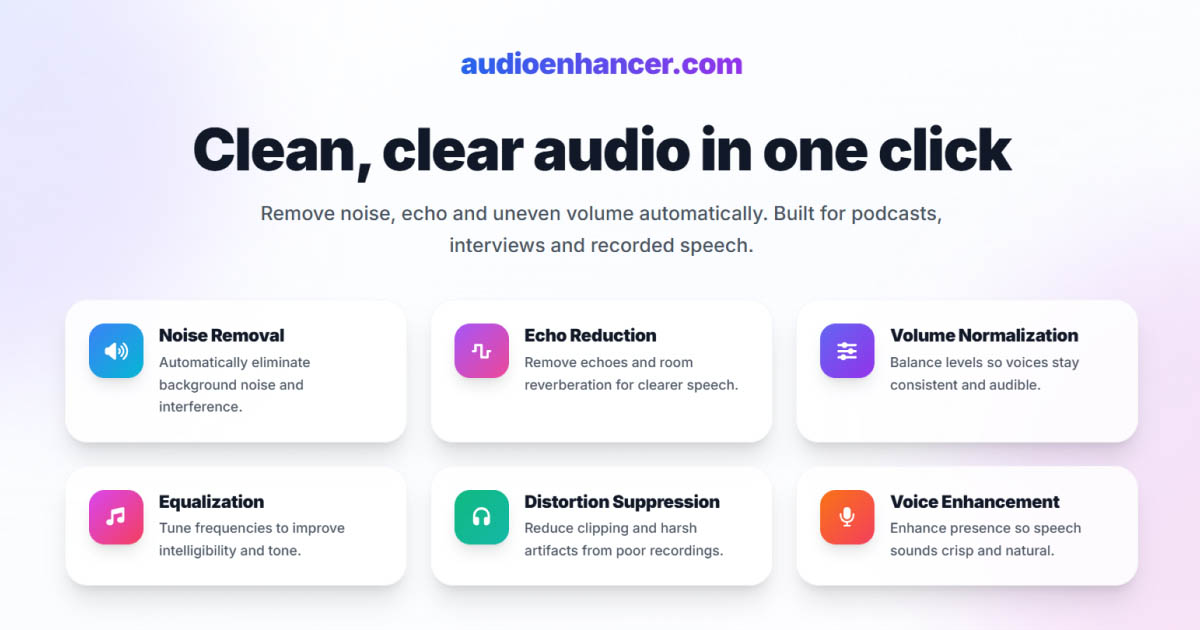

A correção mais fiável: usar um enhancer que prioriza naturalidade

Na prática, quem deixa de ter áudio metálico costuma mudar para ferramentas que:

- são conservadoras por defeito

- adaptam o processamento ao input

- preservam harmónicos e textura vocal

- evitam “fill-in” generativo agressivo

- otimizam para fala natural e não para “máxima limpeza a qualquer custo”

É por isso que algumas ferramentas conseguem lidar com eco pesado e ruído sem aquele “AI sheen”, enquanto outras falham exatamente nesses casos.

A diferença não é quanto limpam.

É como equilibram limpeza com preservação.

Se quiseres um comparativo geral, o guia de melhores enhancers para voz ajuda a perceber quais tendem a ser mais naturais.

Takeaway final

Áudio metálico/robótico aparece quando ferramentas priorizam limpeza agressiva acima de naturalidade.

A solução não é acrescentar mais plugins.

É usar ferramentas que sabem quando parar, para preservar o que faz fala humana soar humana.