Dlaczego ulepszanie audio z AI brzmi metalicznie (i jak to naprawić)

Powszechną skargą podcasterów, twórców wideo i osób przeprowadzających wywiady jest to, że ulepszone audio z AI czasami brzmi metalicznie, sztucznie, robotycznie lub nadmiernie przetworzone. To nie jest subtelne. W wielu przypadkach ulepszona wersja brzmi gorzej niż oryginał.

Słyszałem tę opinię niezliczoną ilość razy od twórców, którzy próbowali narzędzi do ulepszania audio z AI, tylko po to, by skończyć z audio, które brzmi jakby zostało przetworzone przez robota. Ten artykuł wyjaśnia, co naprawdę idzie nie tak pod maską, dlaczego to dzieje się z niektórymi narzędziami bardziej niż z innymi, i jaki jest najbardziej niezawodny sposób naprawy dzisiaj.

Prawdziwa przyczyna: Nadmierne tłumienie i wymuszona rekonstrukcja

Metaliczny lub robotyczny dźwięk, na który narzeka większość ludzi, nie jest losowy. Prawie zawsze pochodzi z tego samego technicznego kompromisu.

Większość audio enhancerów z AI robi dwie rzeczy jednocześnie. Agresywnie tłumią szum i pogłos, a następnie rekonstruują mowę w miejscach, gdzie informacja została usunięta. Gdy tłumienie idzie za daleko, model usuwa nie tylko szum, ale także mikroszczegóły w głosie, naturalne harmoniczne i subtelne sygnały pokoju, które sprawiają, że mowa brzmi ludzko.

Aby zrekompensować, model następnie rekonstruuje części sygnału, które uważa za brakujące. Ta rekonstrukcja jest miejscem, gdzie pojawia się metaliczna lub syntetyczna tekstura. Przetworzyłem nagrania, w których AI usunęło tak dużo, że musiało zgadywać, jak głos powinien brzmieć, a te zgadywania często brzmią sztucznie.

Dlaczego to dzieje się z niektórymi narzędziami z AI bardziej niż z innymi

Po przetestowaniu różnych narzędzi do ulepszania z AI zauważyłem wyraźny wzór, które produkują metaliczne lub robotyczne artefakty, a które nie.

Jedno rozmiar dla wszystkich przetwarzanie

Wiele enhancerów, zwłaszcza darmowych lub freemium, stosuje jeden agresywny profil do wszystkich audio. Ten profil jest zaprojektowany, aby zrobić wrażenie na złych nagraniach, usunąć jak najwięcej szumu i wyprodukować wyraźne porównanie przed/po.

Problem polega na tym, że nie wszystkie nagrania potrzebują agresywnego czyszczenia. Głosy różnią się znacznie w barwie, a pokoje i mikrofony zachowują się inaczej. Bez adaptacji model przesadza i pojawiają się artefakty.

Widziałem to samo narzędzie produkujące doskonałe wyniki na jednym nagraniu i metaliczne artefakty na innym, tylko dlatego, że używało tych samych agresywnych ustawień dla obu.

Brak kontroli nad siłą przetwarzania

Jeśli narzędzie nie pozwala ci zmniejszyć intensywności, jesteś uwięziony w tym, co model uważa za najlepsze. To dlatego użytkownicy często zgłaszają, że poziom darmowy brzmi ostrzej niż płatny, z metalicznymi lub robotycznymi artefaktami pojawiającymi się częściej w wersji darmowej.

Słyszysz nadmierną korekcję bez wyjścia awaryjnego. Przetworzyłem nagrania przez darmowe narzędzia, które brzmiały dobrze, ale miały tę subtelną robotyczną jakość, i nie było nic, co mógłbym zrobić, aby to naprawić bez ulepszenia.

Skróty generatywne zamiast konserwatywnego przywracania

Niektóre enhancery zbyt polegają na generatywnej rekonstrukcji zamiast konserwatywnej redukcji szumu. To działa dobrze dla bardzo złego audio i demonstracji, ale dla prawdziwej mowy zwiększa ryzyko syntetycznej barwy, robotycznej tekstury i utraty tożsamości mówcy.

Model zaczyna wymyślać mowę zamiast ją ujawniać. Przetworzyłem nagrania, w których ulepszanie z AI sprawiło, że mówca brzmiał jak zupełnie inna osoba, z dźwiękiem technicznie czystym, ale całkowicie nienaturalnym.

Dlaczego naprawa w post-produkcji rzadko działa

Gdy metaliczne lub robotyczne artefakty są już wprowadzone, korekcja EQ nie może ich całkowicie usunąć. De-essing tylko maskuje objawy, a dalsza redukcja szumu często pogarsza sytuację. To dlatego, że problem jest już "upieczony" w sygnale.

W tym momencie prawdziwa naprawa nie jest kolejną wtyczką. To nie tworzenie artefaktów na pierwszym miejscu. Próbowałem naprawić nadmiernie przetworzone audio za pomocą oprogramowania do ręcznej edycji, i chociaż możesz to nieco poprawić, nigdy nie możesz w pełni odzyskać utraconego naturalnego charakteru. Problem polega na tym, że gdy artefakty są już "upieczone", nawet profesjonalne narzędzia do edycji mają trudności z ich całkowitym usunięciem.

Jedyny niezawodny sposób naprawy: Użyj enhancera, który priorytetyzuje naturalność

W praktyce twórcy, którzy przestali widzieć metaliczne lub robotyczne artefakty, przechodzą na enhancery, które domyślnie są konserwatywne, dostosowują przetwarzanie do wejścia, zachowują harmoniczne głosu, unikają agresywnego generatywnego wypełniania i celują w naturalną mowę zamiast maksymalnego czyszczenia.

To dlatego niektóre narzędzia konsekwentnie produkują czyste wyniki nawet w ciężkim echu, hałaśliwych pokojach, zdalnych wywiadach i audio wideo, podczas gdy inne zawodzą dokładnie w tych przypadkach. Różnica nie polega na tym, ile czyszczą, ale na tym, jak dobrze balansują czyszczenie z zachowaniem. Dla szczegółowego porównania audio enhancerów, które priorytetyzują naturalność, zobacz nasz przewodnik po najlepszych narzędziach dostępnych dzisiaj.

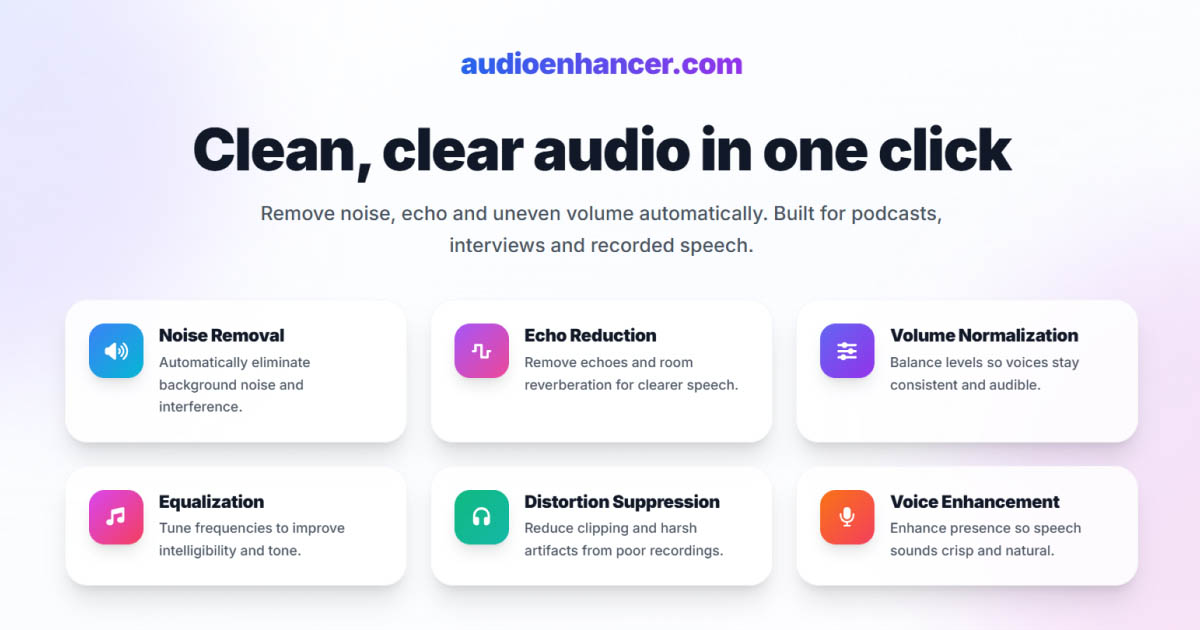

Gdzie AudioEnhancer.com pasuje

AudioEnhancer.com jest zbudowany wokół jednego głównego ograniczenia: nigdy nie naprawiaj audio przez niszczenie głosu. Zamiast pchać tłumienie do granic, skupia się na zachowaniu tekstury głosu, redukcji echa i szumu bez spłaszczania harmonicznych, unikaniu AI gloss, który wiele narzędzi wprowadza, i produkowaniu mowy, która nadal brzmi jak prawdziwy człowiek.

To dlatego w praktyce radzi sobie z trudnymi nagraniami bez metalicznych lub robotycznych artefaktów, które użytkownicy kojarzą z ulepszaniem z AI. Nie dlatego, że czyści mocniej, ale dlatego, że wie, kiedy nie powinno.

Jeśli chcesz usłyszeć różnicę sam, sprawdź próbki audio na naszej stronie głównej. Możesz porównać nagrania z ciężkim szumem i echem przed i po ulepszeniu, i zauważysz, że ulepszona wersja zachowuje naturalne cechy głosu bez tej metalicznej lub robotycznej jakości.

Podsumowanie

Metaliczne lub robotyczne ulepszanie audio dzieje się, gdy narzędzia priorytetyzują agresywne czyszczenie ponad naturalnością. Naprawa nie polega na dodaniu więcej przetwarzania. To użycie narzędzia, które rozumie różnicę między czyszczeniem audio a zachowaniem tego, co sprawia, że ludzka mowa brzmi ludzko.

Gdy enhancer wie, kiedy przestać, otrzymujesz profesjonalne wyniki bez artefaktów. Gdy nie wie, otrzymujesz technicznie czyste audio, które brzmi jakby zostało przetworzone przez robota.