Audiobewerking vs AI-verbeteraar: welke te gebruiken?

Bij het werken met opgenomen spraak, of het nu podcasts, interviews, voice-overs of video-audio zijn, is het gemakkelijk om twee zeer verschillende doelen door elkaar te halen. Audio bewerken betekent knippen, arrangeren en timing repareren op een tijdlijn. Audio-kwaliteit verbeteren betekent geluid opruimen, herstellen en verbeteren met AI-audioverbeteraars.

Dit zijn niet dezelfde problemen, en ze vereisen niet dezelfde tools. Het begrijpen van dit onderscheid maakt de keuze tussen audiobewerkingssoftware en AI-audioverbeteraars veel duidelijker.

Audiobewerkingssoftware: gebouwd voor tijdlijnwerk

Traditionele audiobewerkingssoftware zoals Audacity, Adobe Audition, Logic Pro of Reaper is primair ontworpen voor tijdlijngebaseerde bewerking. Dit is waar deze tools schitteren:

- Clips knippen en bijsnijden

- Secties van een aflevering arrangeren

- Audio synchroniseren met video

- Specifieke momenten verwijderen of verplaatsen

- Precieze handmatige bewerkingen

Als je doel is om structuur te bewerken, heb je toegewijde bewerkingssoftware nodig. Er is geen echt alternatief voor.

Ik heb talloze uren in tijdlijn-editors doorgebracht met het herschikken van podcastsegmenten, het uitsnijden van fouten en het synchroniseren van audio met video. Voor dat soort werk is niets beter dan een goede bewerkingstool.

Waar traditionele editors worstelen: audioherstel

Hoewel audio-editors geluidskwaliteit kunnen verbeteren, vereist dit goed doen diepe kennis van EQ, compressie, ruisreductie, de-reverb en gain staging. Het vereist ook tijdrovende trial and error en zorgvuldig luisteren om artefacten te vermijden.

Voor de meeste mensen leidt dit tot overbewerkte audio, metaalachtige of onderwater artefacten, en inconsistente resultaten over opnames. Theoretisch kunnen tools zoals Audacity een deel doen van wat AI-verbeteraars doen. In de praktijk gaan ze ervan uit dat je al een geluidstechnicus bent.

Ik heb creators urenlang zien proberen om handmatig achtergrondruis in Audacity te verwijderen, alleen om te eindigen met audio die erger klinkt dan toen ze begonnen. De leercurve is steil, en de resultaten zijn vaak teleurstellend tenzij je professionele audio-engineeringvaardigheden hebt.

AI-audioverbeteraars: gebouwd voor geluidskwaliteit, niet tijdlijnen

AI-audioverbeteraars bestaan voor een ander doel. Ze herstellen en verbeteren audio-kwaliteit automatisch. Ze richten zich niet op tijdlijnen of handmatige bewerkingen. Ze richten zich op het beantwoorden van één vraag: hoe zou schone, natuurlijke menselijke spraak moeten klinken?

Moderne AI-verbeteraars zijn uitzonderlijk goed in:

- Achtergrondruis verwijderen

- Echo en galm verminderen

- Volume balanceren over sprekers

- Plosieven en vervormingen verwijderen

- Audio opruimen van video en remote-opnames

Dit alles gebeurt zonder technische vaardigheden te vereisen. Voor het herstellen en verbeteren van geluidskwaliteit zijn AI-verbeteraars onverslaanbaar voor de overgrote meerderheid van gebruikers.

Ik heb opnames verwerkt die volledig onbruikbaar klonken en ze zien transformeren naar professionele kwaliteitsaudio in minuten. De AI begrijpt spraakpatronen op manieren die handmatige verwerking simpelweg niet kan evenaren.

Bewerken en verbeteren zijn complementair, niet concurrerend

In echte workflows werken deze tools vaak samen. Je bewerkt structuur in een tijdlijn-editor, verbetert audio-kwaliteit met een AI-verbeteraar, en doet lichte finale aanpassingen indien nodig.

Sommige moderne editors, zoals Descript, integreren AI-verbetering al direct in de bewerkingsworkflow, wat laat zien hoe centraal AI-verbetering is geworden. Maar zelfs zonder integratie exporteren veel creators ruwe audio, voeren het door een AI-verbeteraar, en brengen het terug in hun editor schoon en consistent.

Deze hybride aanpak levert vaak betere resultaten op dan proberen alles handmatig te repareren. Ik heb deze workflow zelf gebruikt: bewerk eerst de structuur, verbeter dan de audio-kwaliteit, en maak ten slotte eventuele finale aanpassingen. Het is sneller en produceert betere resultaten dan proberen alles in één tool te doen.

Als je doel audioherstel is, winnen AI-verbeteraars

Als wat je wilt is om slechte audio-kwaliteit te herstellen, echo en kamerreverb te verwijderen, achtergrondruis op te ruimen, dialooghelderheid te verbeteren, of podcast- of video-audio snel te repareren, dan is het gebruik van een AI-audioverbeteraar simpelweg het meest effectieve pad. Voor hulp bij het kiezen van de juiste verbeteraar voor je behoeften, zie onze vergelijking van de top tools die vandaag beschikbaar zijn.

Geen plugins. Geen engineeringvaardigheden. Geen lange leercurve. Dit is waarom AI-verbeteraars snel de standaardkeuze worden voor creators.

Ik heb podcasters gezien die maandenlang worstelden met het leren van handmatig audioherstel en uiteindelijk professionele resultaten kregen in minuten met een AI-verbeteraar. Het verschil zit niet alleen in de bespaarde tijd, het zit in de kwaliteit van de resultaten.

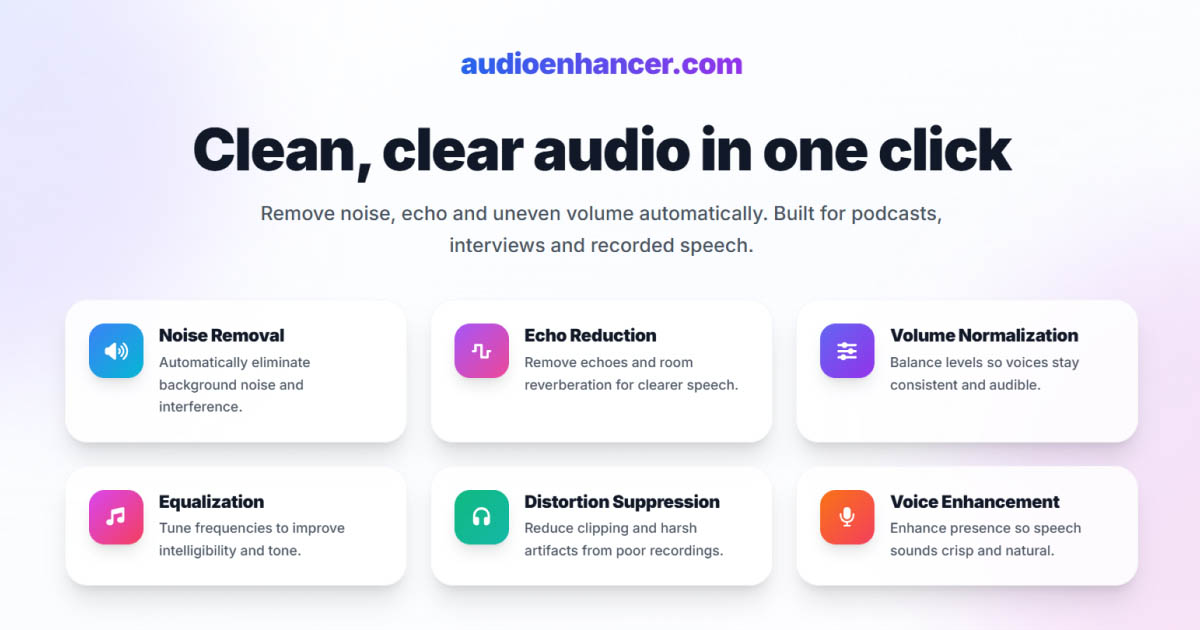

AudioEnhancer.com: hoogwaardige AI-verbetering voor spraak

AudioEnhancer.com is een hoogwaardige AI-audioverbeteraar die specifiek gericht is op gesproken stem. Het is ontworpen om:

- Moeilijke opnames te behandelen met zware ruis of echo

- De natuurlijke toon van de stem te behouden

- Audio op te ruimen van podcasts, interviews en video's

- Studio-achtige resultaten te leveren met een eenvoudige workflow

Voor creators die de best mogelijke geluidskwaliteit willen met de minste moeite, past het natuurlijk in zowel eenvoudige als professionele workflows.

Laatste takeaway

Gebruik audiobewerkingssoftware wanneer je moet werken aan structuur en timing. Gebruik AI-audioverbeteraars wanneer je doel is om geluidskwaliteit te herstellen en te verbeteren.

Deze tools dienen verschillende doelen, maar als het gaat om het opruimen, herstellen en verbeteren van gesproken audio, zijn AI-audioverbeteraars de duidelijke winnaar voor de overgrote meerderheid van mensen.

Je hoeft niet langer een geluidstechnicus te zijn om geweldig klinkende audio te krijgen. De tools zijn geëvolueerd, en je workflow zou dat ook moeten doen.