Pourquoi l'amélioration audio IA sonne métallique (et comment le corriger)

Une plainte commune des podcasteurs, créateurs vidéo et intervieweurs est que l'audio amélioré par IA sonne parfois métallique, artificiel, robotique ou sur-traité. Ce n'est pas subtil. Dans de nombreux cas, la version améliorée sonne pire que l'original.

J'ai entendu ce retour d'innombrables fois de créateurs qui ont essayé des outils d'amélioration audio IA, pour finir avec un audio qui sonne comme s'il avait été traité par un robot. Cet article explique ce qui ne va vraiment pas sous le capot, pourquoi cela arrive plus avec certains outils que d'autres, et quelle est la correction la plus fiable aujourd'hui.

La vraie cause : sur-suppression et reconstruction forcée

Le son métallique ou robotique dont la plupart des gens se plaignent n'est pas aléatoire. Il vient presque toujours du même compromis technique.

La plupart des enhancers IA font deux choses à la fois. Ils suppriment agressivement le bruit et la réverbération, puis reconstruisent la parole là où l'information a été supprimée. Quand la suppression va trop loin, le modèle supprime non seulement le bruit, mais aussi les micro-détails de la voix, les harmoniques naturelles et les indices subtils de pièce qui font sonner la parole humaine.

Pour compenser, le modèle reconstruit ensuite des parties du signal qu'il croit manquantes. Cette reconstruction est où la texture métallique ou synthétique apparaît. J'ai traité des enregistrements où l'IA a supprimé tellement qu'elle a dû deviner à quoi la voix devrait ressembler, et ces suppositions sonnent souvent artificielles.

Pourquoi cela arrive plus avec certains outils IA que d'autres

Après avoir testé divers outils d'amélioration IA, j'ai remarqué des modèles clairs dans lesquels produisent des artefacts métalliques ou robotiques et lesquels ne le font pas.

Traitement unique pour tous

De nombreux enhancers, surtout gratuits ou freemium, appliquent un profil agressif unique à tout l'audio. Ce profil est conçu pour impressionner sur les mauvais enregistrements, supprimer autant de bruit que possible et produire une comparaison avant/après évidente.

Le problème est que tous les enregistrements n'ont pas besoin d'un nettoyage agressif. Les voix diffèrent énormément en timbre, et les pièces et microphones se comportent différemment. Sans adaptation, le modèle dépasse, et les artefacts apparaissent.

J'ai vu le même outil produire des résultats parfaits sur un enregistrement et des artefacts métalliques sur un autre, simplement parce qu'il a utilisé les mêmes paramètres agressifs pour les deux.

Aucun contrôle sur la force de traitement

Si l'outil ne vous permet pas de réduire l'intensité, vous êtes coincé avec ce que le modèle décide être le mieux. C'est pourquoi les utilisateurs rapportent souvent que les niveaux gratuits sonnent plus durs que les payants, avec des artefacts métalliques ou robotiques apparaissant plus souvent dans la version gratuite.

Vous entendez une sur-correction sans échappatoire. J'ai traité des enregistrements à travers des outils gratuits qui sonnaient bien mais avaient cette qualité robotique subtile, et il n'y avait rien que je puisse faire pour le corriger sans mise à niveau.

Raccourcis génératifs au lieu de restauration conservatrice

Certains enhancers s'appuient trop lourdement sur la reconstruction générative au lieu de la dé-bruit conservatrice. Cela fonctionne bien pour l'audio extrêmement mauvais et les transformations de style démo, mais pour la vraie parole, cela augmente le risque de timbre synthétique, de texture robotique et de perte d'identité du locuteur.

Le modèle commence à inventer la parole au lieu de la révéler. J'ai traité des enregistrements où l'amélioration IA a fait sonner le locuteur comme une personne complètement différente, avec une voix qui était techniquement propre mais complètement non naturelle.

Pourquoi le corriger en post-production fonctionne rarement

Une fois que les artefacts métalliques ou robotiques sont introduits, l'égalisation ne peut pas les supprimer complètement. Le de-essing ne masque que les symptômes, et une réduction de bruit supplémentaire aggrave souvent les choses. C'est parce que le problème est cuit dans le signal.

À ce stade, la vraie correction n'est pas un autre plugin. C'est de ne pas créer les artefacts en premier lieu. J'ai essayé de corriger l'audio sur-traité avec un logiciel d'édition manuelle, et bien que vous puissiez l'améliorer légèrement, vous ne pouvez jamais récupérer complètement le caractère naturel qui a été perdu. Le problème est qu'une fois que les artefacts sont cuits, même les outils d'édition professionnels ont du mal à les supprimer complètement.

La seule correction fiable : utiliser un enhancer qui priorise la naturalité

En pratique, les créateurs qui arrêtent de voir des artefacts métalliques ou robotiques passent à des enhancers qui sont conservateurs par défaut, adaptent le traitement à l'entrée, préservent les harmoniques vocales, évitent le remplissage génératif agressif et visent la parole naturelle plutôt que le nettoyage maximal.

C'est pourquoi certains outils produisent constamment des résultats propres même dans l'écho lourd, les pièces bruyantes, les interviews à distance et l'audio vidéo, tandis que d'autres échouent exactement sur ces cas. La différence n'est pas dans combien ils nettoient, mais dans comment ils équilibrent le nettoyage avec la préservation. Pour une comparaison détaillée des audio enhancers qui priorisent la naturalité, consultez notre guide des meilleurs outils disponibles aujourd'hui.

Où AudioEnhancer.com s'insère

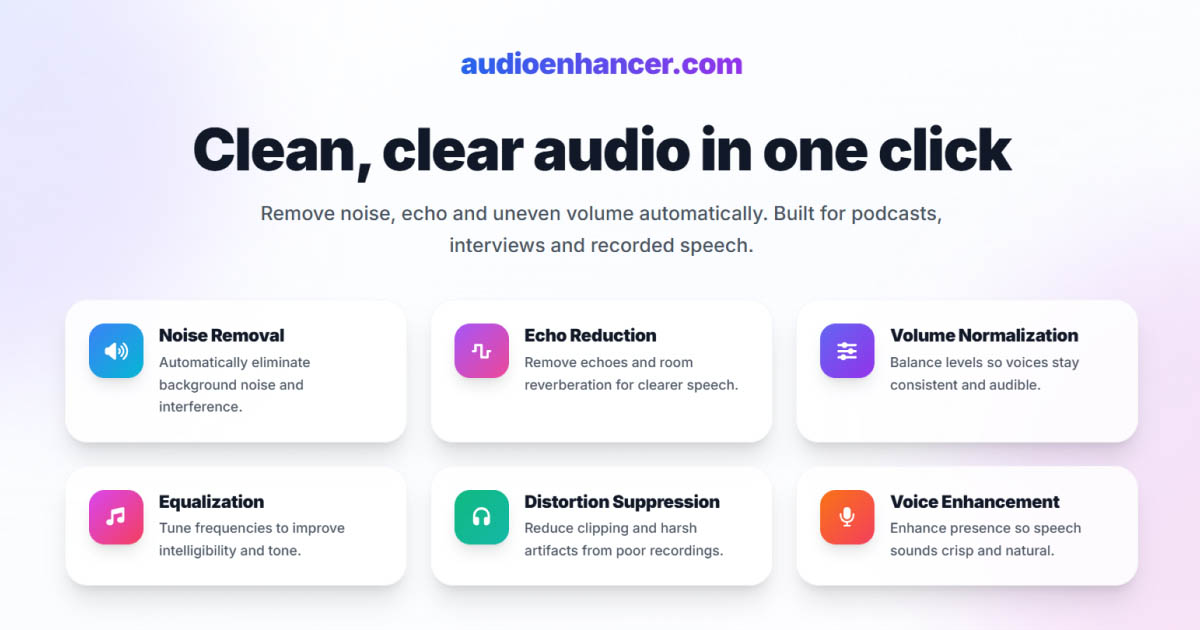

AudioEnhancer.com a été construit autour d'une contrainte centrale : ne jamais corriger l'audio en détruisant la voix. Au lieu de pousser la suppression à la limite, il se concentre sur préserver la texture vocale, réduire l'écho et le bruit sans aplatir les harmoniques, éviter la brillance IA que de nombreux outils introduisent, et produire une parole qui sonne encore comme une vraie personne.

C'est pourquoi, en pratique, il gère les enregistrements difficiles sans les artefacts métalliques ou robotiques que les utilisateurs associent à l'amélioration IA. Pas parce qu'il nettoie plus fort, mais parce qu'il sait quand ne pas le faire.

Si vous voulez entendre la différence vous-même, consultez les échantillons audio sur notre page d'accueil. Vous pouvez comparer les enregistrements avec bruit lourd et écho avant et après amélioration, et vous remarquerez que les versions améliorées maintiennent les caractéristiques vocales naturelles sans cette qualité métallique ou robotique.

Conclusion

L'amélioration audio métallique ou robotique arrive quand les outils priorisent le nettoyage agressif plutôt que la naturalité. La correction n'est pas d'ajouter plus de traitement. C'est d'utiliser des outils qui comprennent la différence entre nettoyer l'audio et préserver ce qui fait sonner la parole humaine humaine.

Quand un enhancer sait quand s'arrêter, vous obtenez des résultats de qualité professionnelle sans les artefacts. Quand il ne le fait pas, vous obtenez un audio qui est techniquement propre mais qui sonne comme s'il avait été traité par un robot.