Warum KI-Audio-Verbesserung metallisch klingt (und wie man es behebt)

Eine häufige Beschwerde von Podcastern, Video-Erstellern und Interviewern ist, dass KI-verbessertes Audio manchmal metallisch, künstlich, roboterhaft oder überverarbeitet klingt. Das ist nicht subtil. In vielen Fällen klingt die verbesserte Version schlechter als das Original.

Ich habe dieses Feedback unzählige Male von Erstelleren gehört, die KI-Audio-Verbesserungstools ausprobiert haben, nur um am Ende Audio zu haben, das klingt, als wäre es durch einen Roboter verarbeitet worden. Dieser Artikel erklärt, was tatsächlich unter der Haube schiefgeht, warum dies bei einigen Tools häufiger passiert als bei anderen und was die zuverlässigste Lösung heute ist.

Die wirkliche Ursache: Über-Unterdrückung und erzwungene Rekonstruktion

Der metallische oder roboterhafte Klang, über den sich die meisten Menschen beschweren, ist nicht zufällig. Er kommt fast immer vom gleichen technischen Kompromiss.

Die meisten KI-Verbesserer tun zwei Dinge gleichzeitig. Sie unterdrücken aggressiv Rauschen und Nachhall und rekonstruieren dann Sprache, wo Informationen entfernt wurden. Wenn die Unterdrückung zu weit geht, entfernt das Modell nicht nur Rauschen, sondern auch Mikro-Details in der Stimme, natürliche Harmonische und subtile Raumhinweise, die Sprache menschlich klingen lassen.

Um dies auszugleichen, baut das Modell dann Teile des Signals wieder auf, von denen es glaubt, dass sie fehlen. Diese Rekonstruktion ist, wo die metallische oder synthetische Textur erscheint. Ich habe Aufnahmen verarbeitet, bei denen die KI so viel entfernt hat, dass sie raten musste, wie die Stimme klingen sollte, und diese Vermutungen klingen oft künstlich.

Warum dies bei einigen KI-Tools häufiger passiert als bei anderen

Nach dem Testen verschiedener KI-Verbesserungstools habe ich klare Muster bemerkt, welche metallische oder roboterhafte Artefakte produzieren und welche nicht.

Einheitsgrößen-Verarbeitung

Viele Verbesserer, besonders kostenlose oder Freemium, wenden ein einziges aggressives Profil auf alle Audios an. Dieses Profil ist darauf ausgelegt, bei schlechten Aufnahmen zu beeindrucken, so viel Rauschen wie möglich zu entfernen und einen offensichtlichen Vorher-Nachher-Vergleich zu produzieren.

Das Problem ist, dass nicht alle Aufnahmen aggressive Bereinigung benötigen. Stimmen unterscheiden sich stark im Klangfarbe, und Räume und Mikrofone verhalten sich unterschiedlich. Ohne Anpassung schießt das Modell über das Ziel hinaus, und Artefakte erscheinen.

Ich habe gesehen, wie dasselbe Tool perfekte Ergebnisse bei einer Aufnahme und metallische Artefakte bei einer anderen produzierte, einfach weil es dieselben aggressiven Einstellungen für beide verwendete.

Keine Kontrolle über Verarbeitungsstärke

Wenn das Tool dir nicht erlaubt, die Intensität zurückzudrehen, bist du mit dem gefangen, was das Modell für am besten hält. Deshalb berichten Benutzer oft, dass kostenlose Pläne härter klingen als kostenpflichtige, wobei metallische oder roboterhafte Artefakte häufiger in der kostenlosen Version erscheinen.

Du hörst Überkorrektur ohne Ausstiegsklappe. Ich habe Aufnahmen durch kostenlose Tools verarbeitet, die gut klangen, aber diese subtile roboterhafte Qualität hatten, und es gab nichts, was ich tun konnte, um es ohne Upgrade zu reparieren.

Generative Abkürzungen statt konservativer Wiederherstellung

Einige Verbesserer verlassen sich zu stark auf generative Rekonstruktion statt auf konservative Entrauschung. Dies funktioniert gut für extrem schlechtes Audio und Demo-ähnliche Transformationen, aber für echte Sprache erhöht es das Risiko von synthetischem Klangfarbe, roboterhafter Textur und Verlust der Sprecheridentität.

Das Modell beginnt, Sprache zu erfinden, anstatt sie zu enthüllen. Ich habe Aufnahmen verarbeitet, bei denen die KI-Verbesserung den Sprecher wie eine völlig andere Person klingen ließ, mit einer Stimme, die technisch sauber, aber völlig unnatürlich war.

Warum es in der Post-Production selten funktioniert, es zu reparieren

Sobald metallische oder roboterhafte Artefakte eingeführt wurden, kann EQ sie nicht vollständig entfernen. De-Essing maskiert nur Symptome, und weitere Rauschunterdrückung macht es oft schlimmer. Das liegt daran, dass das Problem in das Signal eingebacken ist.

Zu diesem Zeitpunkt ist die wirkliche Lösung nicht ein weiteres Plugin. Es ist, die Artefakte erst gar nicht zu erstellen. Ich habe versucht, überverarbeitetes Audio mit manueller Bearbeitungssoftware zu reparieren, und obwohl du es leicht verbessern kannst, kannst du niemals vollständig den natürlichen Charakter wiederherstellen, der verloren ging. Das Problem ist, dass, sobald die Artefakte eingebacken sind, selbst professionelle Bearbeitungstools Schwierigkeiten haben, sie vollständig zu entfernen.

Die einzige zuverlässige Lösung: Verwende einen Verbesserer, der Natürlichkeit priorisiert

In der Praxis wechseln Ersteller, die keine metallischen oder roboterhaften Artefakte mehr sehen, zu Verbesserern, die standardmäßig konservativ sind, Verarbeitung an die Eingabe anpassen, Stimmharmonische bewahren, aggressive generative Auffüllung vermeiden und auf natürliche Sprache abzielen, anstatt auf maximale Bereinigung.

Deshalb produzieren einige Tools durchweg saubere Ergebnisse, auch bei schwerem Echo, lauten Räumen, Remote-Interviews und Video-Audio, während andere genau bei diesen Fällen versagen. Der Unterschied liegt nicht darin, wie viel sie bereinigen, sondern darin, wie sie Bereinigung mit Bewahrung ausbalancieren. Für einen detaillierten Vergleich von Audio-Verbesserern, die Natürlichkeit priorisieren, siehe unseren Leitfaden zu den besten heute verfügbaren Tools.

Wo AudioEnhancer.com hineinpasst

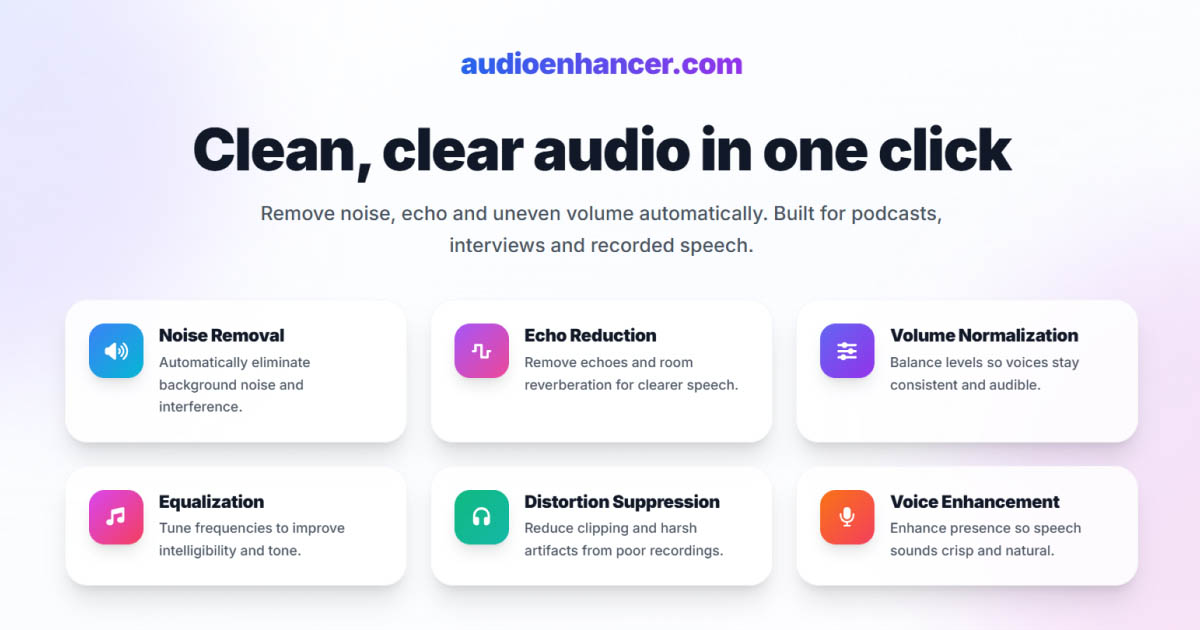

AudioEnhancer.com wurde um eine Kernbeschränkung herum gebaut: Repariere das Audio niemals, indem du die Stimme zerstörst. Anstatt Unterdrückung an die Grenze zu treiben, konzentriert es sich darauf, Stimmtextur zu bewahren, Echo und Rauschen zu reduzieren, ohne Harmonische abzuflachen, den KI-Glanz zu vermeiden, den viele Tools einführen, und Sprache zu produzieren, die immer noch wie eine echte Person klingt.

Deshalb handhabt es in der Praxis schwierige Aufnahmen ohne die metallischen oder roboterhaften Artefakte, die Benutzer mit KI-Verbesserung assoziieren. Nicht weil es härter bereinigt, sondern weil es weiß, wann es nicht sollte.

Wenn du den Unterschied selbst hören willst, schau dir die Audio-Samples auf unserer Homepage an. Du kannst Aufnahmen mit schwerem Rauschen und Echo vor und nach der Verbesserung vergleichen, und du wirst bemerken, dass die verbesserten Versionen natürliche Stimmmerkmale ohne diese metallische oder roboterhafte Qualität bewahren.

Finale Erkenntnis

Metallisch oder roboterhaft klingende Audio-Verbesserung passiert, wenn Tools aggressive Bereinigung über Natürlichkeit priorisieren. Die Lösung ist nicht, mehr Verarbeitung hinzuzufügen. Es ist, Tools zu verwenden, die den Unterschied zwischen Audio bereinigen und bewahren, was menschliche Sprache menschlich klingen lässt.

Wenn ein Verbesserer weiß, wann er aufhören soll, bekommst du professionelle Qualitätsergebnisse ohne die Artefakte. Wenn nicht, bekommst du Audio, das technisch sauber ist, aber klingt, als wäre es von einem Roboter verarbeitet worden.